Wer mit KI-Systemen arbeitet, begegnet Antworten, die plausibel wirken, aber nicht stimmen. Das liegt an der Art, wie Sprachmodelle trainiert werden: Sie berechnen die wahrscheinlichste Fortsetzung eines Textes, statt Fakten zu prüfen. Genau an dieser Stelle werden Grounding und Halluzination relevant.

Grounding sorgt dafür, dass ein Modell nicht aus Mustern heraus spekuliert, sondern sich auf dokumentierte Informationen stützt. Halluzinationen entstehen, wenn diese Basis fehlt oder wenn das Modell aufgrund fehlender Daten versucht, eine Antwort zu konstruieren. Beide Mechanismen sind entscheidend, um Systeme stabil betreiben zu können – besonders in regulierten oder sensiblen Bereichen.

Warum Grounding unverzichtbar ist

Grounding beschreibt die Verbindung eines Modells zu eindeutigen, überprüfbaren Daten. Es trennt den Prozess der Sprachgenerierung von der fachlichen Richtigkeit der Inhalte. Damit eine KI belastbare Aussagen trifft, müssen Herkunft, Struktur und Aktualität der verwendeten Informationen eindeutig dokumentiert sein. Dieser Mechanismus verhindert, dass Modelle nur aufgrund von Wahrscheinlichkeiten argumentieren.

Fehlt Grounding, entstehen Aussagen, die sprachlich überzeugend, aber fachlich falsch sein können. Besonders in der Medizin, im Rechtsbereich oder in technischen Anwendungen führt das schnell zu Problemen. Modelle liefern dann Ergebnisse, die zwar konsistent formuliert sind, aber keinen Bezug zur tatsächlichen Datenlage haben. Grounding schafft hier die notwendige Stabilität.

Wie Halluzinationen entstehen

Eine Halluzination liegt vor, wenn ein Modell Inhalte erzeugt, die sich nicht auf eine verifizierbare Quelle beziehen. Das kann von erfundenen Details bis hin zu unpassenden Schlussfolgerungen reichen. Ursache ist das Grundprinzip der Modelle: Sie legen Wert auf wahrscheinliche Formulierungen, nicht auf korrekte Inhalte. Selbst gut trainierte Systeme sind davon nicht ausgenommen.

Halluzinationen treten besonders dann auf, wenn Eingaben unklar sind oder wenn das Modell aufgrund fehlender Daten eine Antwort erzwingen soll. Sie sind keine Fehlfunktion, sondern eine systemische Eigenschaft. Deshalb lässt sich das Risiko nur durch klare Regeln, saubere Daten und technische Einschränkungen reduzieren.

Grounding in der Praxis

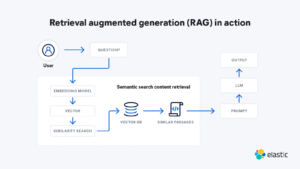

Grounding ist überall dort relevant, wo Vorgaben verbindlich sind und sich Inhalte regelmäßig ändern. Besonders in Verwaltungsprozessen zeigt sich, wie wichtig eine eindeutige Datenbasis ist. Moderne Systeme nutzen dafür Verfahren wie RAG (Retrieval-Augmented Generation). Dabei trennt sich die Formulierung der Antwort von ihren Quellen: Das Modell erzeugt den Text, greift aber ausschließlich auf geprüfte Datensätze, Rechtsgrundlagen oder Richtlinien zu, die über eine Such- oder Datenbankschicht bereitgestellt werden.

Ein praktisches Beispiel: Ein KI-System soll einen Bescheidentwurf erstellen, der sich auf eine aktuelle Verwaltungsrichtlinie stützt. Ohne Grounding würde das Modell eine wahrscheinliche Formulierung wählen und dabei Paragraphen ungenau zitieren oder Passagen ergänzen, die in der geltenden Fassung nicht vorkommen. Mit RAG ruft das System dagegen die verbindliche Rechtsquelle ab, nutzt die dort hinterlegten Versionen und formuliert den Text strikt innerhalb dieses Rahmens. So bleibt der Entwurf fachlich korrekt und rechtssicher.

Typische Einsatzfelder für Grounding

Medizinische Kodierung und klinische Dokumentenanalyse

Verwaltungsvorgänge mit festen Rechtsgrundlagen

Technische Dokumentation und produktrelevante Daten

Compliance-Prozesse mit verbindlichen Regelwerken

Quelle Schaubild: elastic

Datenqualität, Versionierung und organisatorische Maßnahmen

Datenqualität ist die Grundlage für funktionierendes Grounding. Nur klar strukturierte, konsistent gepflegte und nachvollziehbar versionierte Daten verhindern, dass KI-Systeme auf veraltete oder widersprüchliche Inhalte zugreifen. Das gilt für technische Dokumente, Produktinformationen, juristische Vorgaben und interne Wissensbestände gleichermaßen. Fehlende Aktualität oder unklare Datenstände führen unmittelbar zu falschen Ergebnissen.

Auch organisatorisch braucht es klare Prozesse. Unternehmen müssen Zuständigkeiten für Datenpflege, Prüfzyklen und Qualitätskontrollen definieren. Dazu gehören klare Regeln, wie Systeme mit Unsicherheiten umgehen sollen, sowie Verfahren, die auffällige Ergebnisse sichtbar machen und korrigierbar halten. Nur wenn technische und organisatorische Maßnahmen zusammenarbeiten, bleibt ein KI-System langfristig stabil.

Wichtige Punkte für stabile Ergebnisse

Daten müssen eindeutig strukturiert, konsistent gepflegt und klar versioniert sein.

Systeme dürfen keine Antwort erzwingen und müssen Unsicherheiten melden.

Verantwortlichkeiten für Datenpflege und Qualitätskontrollen müssen festgelegt sein.

Monitoring, Feedback und regelmäßige Prüfungen stabilisieren den laufenden Betrieb.

Häufig gestellte Fragen zu Grounding und Halluzination in KI-Systemen

Wie lässt sich feststellen, ob eine Antwort halluziniert ist?

Eine Antwort gilt als halluziniert, wenn sie sich nicht auf eine nachvollziehbare und überprüfbare Quelle zurückführen lässt. Systeme, die Referenzen ausgeben, erleichtern diese Prüfung.

Reicht Grounding aus, um Halluzinationen auszuschließen?

Nein. Grounding reduziert das Risiko, aber Sprachmodelle bleiben probabilistisch. Es braucht klare Regeln, Datenqualität und fortlaufende Kontrollen.

Welche Daten eignen sich für Grounding?

Geeignet sind eindeutig strukturierte und gepflegte Datenbestände wie technische Dokumentationen, Produktdaten, juristische Vorgaben oder medizinische Regelwerke. Entscheidend ist deren Konsistenz und Versionierung.

Wie wird Grounding technisch umgesetzt?

Typische Verfahren sind Retrieval-Mechanismen, Datenbanken, Vektorsuchen oder API-Schnittstellen. Das Modell erzeugt die Formulierung, während die Inhalte aus verifizierten Quellen stammen.